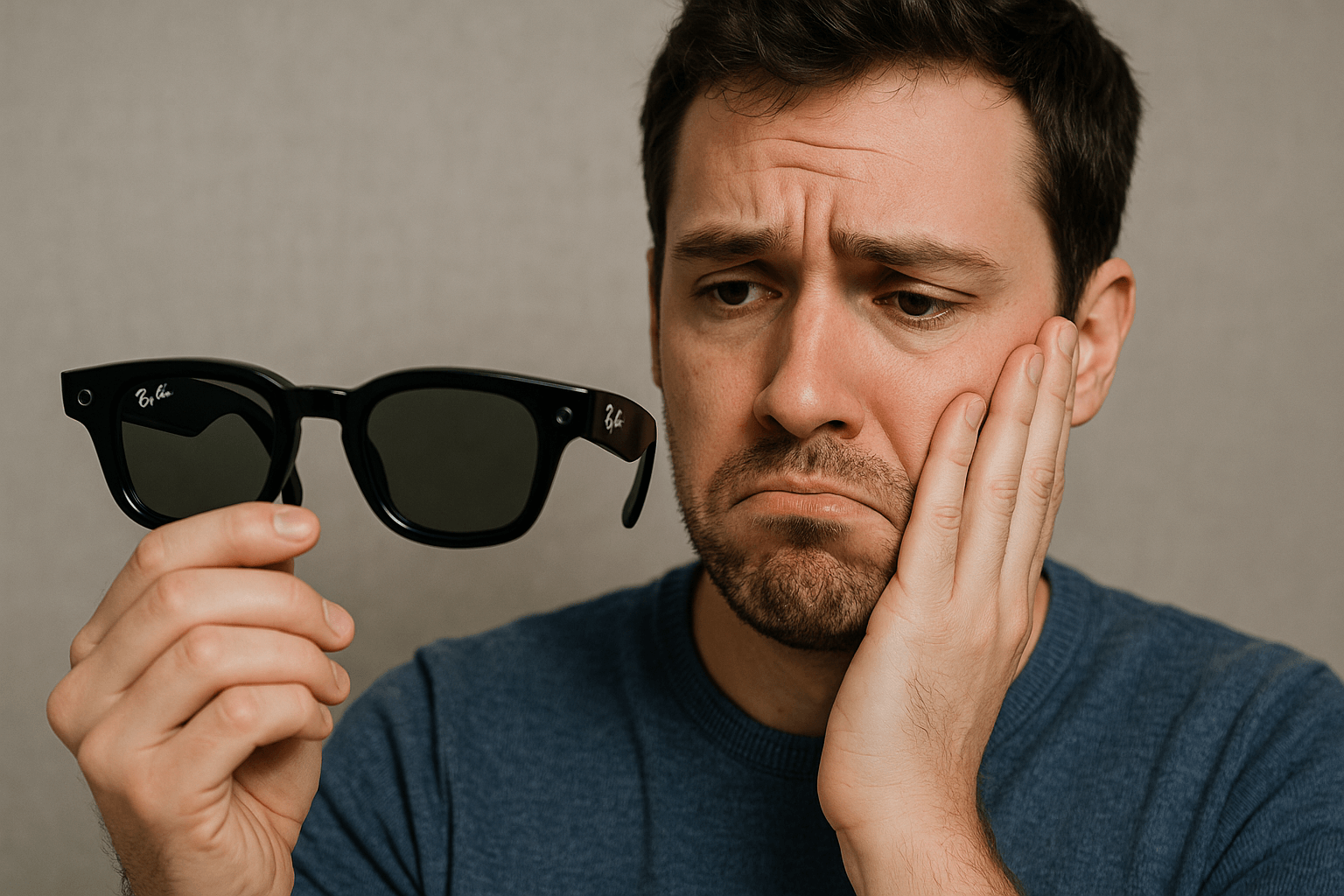

Hace poco conseguí los Meta Ray-Ban (No los Ray-Ban Stories que son los anteriores ni los nuevos que van a salir Ray-Ban display), estos son manejados principalmente con comandos de voz. En este artículo les contaré mis 2 primeras semanas usándolos, y siendo honesto, tenía expectativas mucho más altas. ¿Por qué? Porque la promesa era clara: unos lentes modernos, que funcionaran tanto en interiores como en exteriores, con inteligencia artificial integrada capaz de resolver problemas y, en un futuro, la posibilidad de conectar aplicaciones para apoyar tareas diarias.

Lo que encontré fue otra historia. Los Meta aún no son ese producto revolucionario que esperaba. Todavía están muy atrás de lo que prometen, y en esta publicación quiero compartir cuáles eran mis expectativas, qué sí cumplen y qué quedó a deber.

Primeras impresiones: lo bueno y lo decepcionante.

Desde el primer día que los saqué de la caja ya tenía la emoción de probarlos al máximo. Me intrigaba especialmente la tecnología de Transitions, esta tecnología que hace oscurecer automáticamente los lentes al salir al sol y aclararlos en interiores. Pero la decepción fue inmediata. Desde afuera parece que se oscurecen, pero desde adentro, desde mi punto de vista apenas se nota un 5% y la verdad es que no oscurecen nada, no ayudan a bloquear la luz. En la práctica, no sirven y hasta terminan lastimando los ojos por querer usarlos en luz y el sol.

Como diseñador gráfico, el cuidado de mi vista siempre ha sido una prioridad debido a la cantidad de horas que paso en pantallas y esperaba que esta fuera una función esencial. Me veía cambiando entre los lentes meta y mis lentes de sol constantemente, lo cual, pues, era bastante incómodo, esto debido a que los Transitions no cumplían. La ironía fue que intenté grabar un video usando los lentes de sol tradicionales y al dar el toque para grabar algún momento especial es cuando me daba cuenta de que no eran los Ray-Ban Meta. Entonces de nuevo me cambiaba de lentes.

La inteligencia artificial: más “Alexa” que “Jarvis”

El punto que más me emocionaba era la IA. Si me imaginaba algo tipo ChatGPT o como la película Her, en donde puedo tener una conversación inteligente con una especie de acompañante digital capaz de contestar preguntas al vuelo, ayudarme mientras camino, resolver dudas rápidas o incluso interactuar con otras aplicaciones como Asana o Google Calendar.

La realidad de la tecnología de la IA de META es mucho más limitada, por lo menos en español y en México con mi experiencia. Solo responde lo básico del clima, pone temporizadores (cuando quiere) y responde preguntas que están en Wikipedia, entre otras preguntas muy sencillas de buscador pre inteligencia artificial. Una de las situaciones reales es cuando estaba escuchando un pódcast de «chisme Corporativo» (muy recomendado) y en la conversación del pódcast salió una frase que dijo una de las hosts, que fue: “hizo de su vida un cacahuate”. A pesar de que tenía una vaga idea de lo que significa, quise preguntarle a la IA y la pregunta fue: Hey META, me puedes decir que significa la frase: “hizo de su vida un cacahuate” y me puedes decir el origen etimológico? Y me contesto simplemente: No tengo la respuesta, pero quieres saber más de cacahuates? Definitivamente, esta no es IA y ahí me di cuenta de la estafa del producto. En lugar de sentirme acompañado por un “Jarvis” de Iron Man, o la IA de ChatGPT, la experiencia fue más parecida a hablar con una versión básica de Alexa.

Todavía no hay integración con herramientas externas, y eso limita muchísimo su potencial. Es claro que la IA de Meta aún tiene mucho camino por recorrer. Durante mis vacaciones incluso volví a ver la película Her. Me llamó la atención la diferencia tan grande entre esa visión futurista de una IA que no solo entiende, sino que evoluciona, y lo que tenemos hoy en día. No busco, por supuesto, una relación amorosa como en la película, pero sí una inteligencia artificial con la que se pueda conversar de verdad. Herramientas como OpenAI o Gemini ya lo permiten, especialmente en inglés, pero en el caso de los Meta —al menos en español y en México— la experiencia está lejos de ser satisfactoria.

Lo que sí funciona y sorprende

No todo fue negativo. Hay puntos que realmente disfruté:

- Audio abierto integrado:

Los altavoces en las patillas de los lentes son cómodos, discretos y prácticos. Puedes escuchar un pódcast o música sin necesidad de audífonos, y lo mejor es que no aíslan del entorno. Puedes seguir platicando con tu familia o escuchar si alguien te habla, algo muy útil en la vida diaria en mi caso. - Cámara para fotos y video:

Tomar fotos o grabar videos con solo un toque es realmente cómodo. Me encontré capturando momentos cotidianos que normalmente no grabaría porque tendría las manos ocupadas. Este punto es probablemente el más divertido y práctico. - Batería y carga:

Aunque la duración de la batería ronda entre 3 y 5 horas, no tuve problemas porque no los usaba de forma continua. Bastaba un descanso de 20 minutos para que volvieran a estar listos. Para mi ritmo de trabajo, fue suficiente.

Estas funciones no son revolucionarias (existen otros lentes con cámara o audio abierto), pero en conjunto ofrecen una experiencia fresca que sí disfruté, sobre todo en el día a día.

Experiencia en trabajo vs. vacaciones

Algo interesante fue notar cómo la utilidad de los Meta cambia dependiendo del contexto. En el trabajo, realmente no los necesité tanto: mi labor es de oficina, tengo computadora, pantalla, cámara y toda la inteligencia artificial que requiero en un clic. Ahí los lentes no me aportaron nada extra. En cambio, durante unas vacaciones recientes sí los aproveché mucho más. La cámara fue la protagonista: grabé y fotografié demasiado, incluso más de lo que hubiera esperado. Y aquí se presentó un dilema moderno: al tener la cámara siempre lista, terminé registrando tantos momentos que, en la práctica, muchos quedarán olvidados en la nube.

Haciendo paréntesis se me hizo esto último un contraste interesante con las cámaras análogas del pasado. Antes, con cámaras analógicas, cada foto tenía un valor especial porque eran limitadas. Luego, con las digitales, empezamos a acumular miles que rara vez revisamos. Ahora, con los Meta, esa sobreproducción se multiplica, especialmente con los videos. En una semana de vacaciones grabé más de 70 clips, muchos de los cuales probablemente nunca vuelva a ver. Paradójicamente, esto hace que los recuerdos pierdan un poco de su magia.

Entre expectativas y realidad

Al final, los dos grandes pilares en los que yo tenía más esperanza —la inteligencia artificial y la tecnología Transitions— fueron los que más decepcionaron. Y aunque hay funciones prácticas que disfruté, la experiencia todavía no está ni cerca de lo que imaginaba.

Debido a que para mí es un dealbreaker si la IA no funciona y que no me protejan del sol, los tuve que regresar y sigo probando alternativas. Punto importante. Yo no uso o hago llamadas hoy en día. No uso el teléfono y aún no me acostumbro a usar mensajes de WhatsApp por voz, por lo tanto, no puedo platicar de mi experiencia y beneficios en esta parte de las funcionalidades.

Ahora que los regresé, si extraño usarlos, pero no tanto debido a que las funcionalidades claves para mí no cumplían su propósito.

Los Ray-Ban Meta son una muestra de hacia dónde se dirige la tecnología, pero todavía están en una etapa inicial. La promesa es grande, pero la ejecución no llega al nivel esperado. Ya vienen los Ray-Ban Display, una nueva versión que promete ya elementos visuales, pantalla en el mismo lente. En poco tiempo podremos ver esto; sin embargo, a mí me emociona aún más el futuro sin pantalla en donde la IA trabaje contigo por voz, acepte tus instrucciones, te dé sugerencias y se integre a las diversas aplicaciones de productividad como Asana, Google, Pipedrive, Outlook entre otros haciendo una experiencia que se pueda decir ahora si futurista.

0 comentarios